ARC-AGI-3 출시: 인간 100% vs AI 1% 미만 — GPT-5도 Claude도 풀지 못하는 벤치마크가 왔다

목차

GPT-5, Claude, Gemini — 지금 가장 뛰어나다는 AI 모델들이 모두 1% 미만의 점수를 받은 테스트가 어제(3월 25일) 공개되었습니다. 반면 인간은 100%를 받습니다. 과연 이 테스트가 뭐길래?

🎮 ARC-AGI-3이 뭔가요?

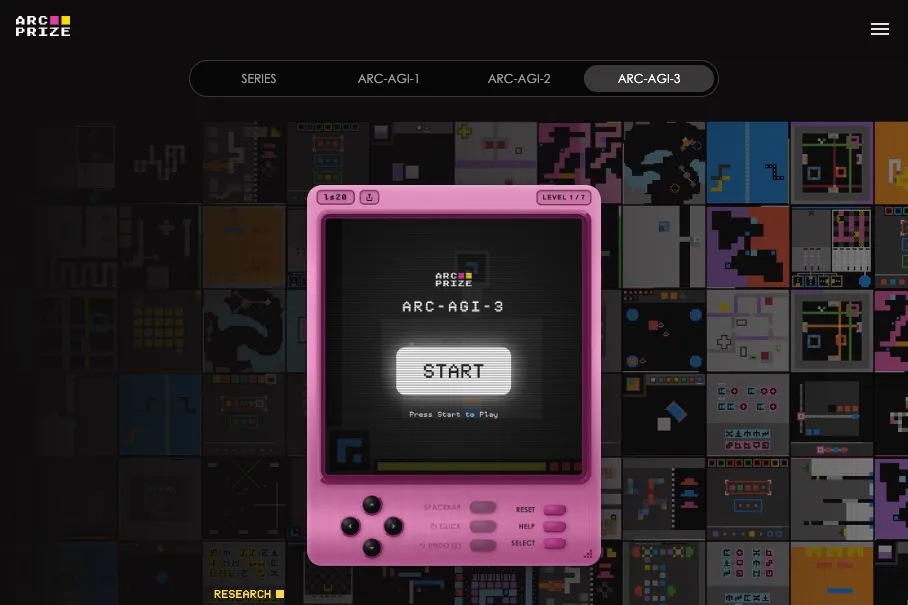

ARC-AGI-3은 ARC Prize Foundation이 만든 인터랙티브 추론 벤치마크입니다. 이전 버전(ARC-AGI-1, 2)이 정적 퍼즐이었다면, 이번 3버전은 완전히 다릅니다. AI 에이전트가 비디오 게임 같은 환경에서 직접 플레이하면서 규칙을 스스로 파악하고, 목표를 달성해야 합니다.

핵심은 이겁니다: 아무런 설명서가 없습니다. 자연어 인스트럭션도, 힌트도 없이 던져놓고 "알아서 해봐"라는 거죠. 환경을 탐색하고, 규칙을 추론하고, 전략을 세워서, 최소한의 스텝으로 목표를 달성해야 합니다. 효율적으로 할수록 높은 점수를 받습니다.

📊 왜 AI가 1% 미만인가

François Chollet(프랑수아 숄레)은 Keras를 만든 분이자 ARC Prize Foundation 공동 창립자입니다. 그가 이 벤치마크를 만든 이유는 명확합니다.

"지능이란 새로운 것을 이해하는 효율성이다. 룩업 테이블로 모든 답을 외워버리면 그건 기술이지 지능이 아니다."

현재 LLM들은 기본적으로 패턴 매칭과 암기에 의존합니다. 학습 데이터에서 본 적 있는 패턴을 재조합하는 건 잘하지만, 완전히 새로운 환경에서 처음 보는 규칙을 실시간으로 학습하는 건 못 합니다. ARC-AGI-3이 정확히 이 약점을 찌릅니다.

Fast Company와의 인터뷰에서 숄레는 이렇게 말했습니다.

"가장 최첨단 AI 시스템이 풀지 못하는 문제를 아이도 풀 수 있다면, 그건 우리가 뭔가 중요한 걸 놓치고 있다는 빨간 경고등이다."

🔧 기술적으로 어떻게 작동하나

ARC-AGI-3의 구성을 정리하면 이렇습니다.

- 1,000개 이상의 레벨, 150개 이상의 환경으로 구성

- 각 환경은 턴 기반 인터랙션 — 에이전트가 행동을 선택하고, 환경이 반응

- 스킬 습득 효율성을 시간에 따라 측정 (단순 정답률이 아님)

- 장기 계획(long-horizon planning)과 희소 피드백(sparse feedback) 환경

- 경험 기반 적응 — 여러 스텝에 걸쳐 전략을 수정해야 함

이전 벤치마크들과 결정적으로 다른 점은 "시간에 걸친 지능 측정"입니다. 최종 답만 보는 게 아니라, 계획 수립 능력, 메모리 압축, 새로운 증거가 나타났을 때 기존 믿음을 업데이트하는 능력까지 평가합니다.

💰 상금 85만 달러, Kaggle 대회도 시작

Kaggle에서 ARC Prize 2026 대회가 이미 시작되었습니다. 주요 일정은 다음과 같습니다.

- 2026년 3월 25일 — 대회 시작

- 6월 30일 — ARC-AGI-3 마일스톤 #1

- 9월 30일 — ARC-AGI-3 마일스톤 #2

- 11월 2일 — 최종 제출 마감

- 12월 4일 — 수상자 발표

총 상금은 85만 달러(약 12억 원)입니다. 에이전트의 성능은 ARC-AGI-3 게임 환경에서의 퍼포먼스로 결정됩니다.

🤔 개발자로서 이게 왜 중요한가

솔직히 말하면, 지금까지 AI 벤치마크는 좀 허무한 면이 있었습니다. MMLU에서 "PhD 레벨 지능"이라고 자랑해봤자, 실제 업무에 AI 에이전트를 붙여보면 예상 못한 상황에서 멍하니 서 있는 경우가 허다하니까요.

ARC-AGI-3이 의미 있는 이유는 이겁니다:

- 에이전트 개발의 방향타 — "내가 만든 에이전트가 얼마나 똑똑한가"를 객관적으로 측정할 수 있는 기준이 생겼습니다

- 암기 vs 추론의 구분 — 학습 데이터를 더 때려넣는다고 점수가 오르지 않습니다. 아키텍처 자체의 혁신이 필요합니다

- 오픈소스 툴킷 제공 — 공식 문서와 SDK가 제공되어 누구나 자기 에이전트를 테스트할 수 있습니다

저도 개인적으로 ARC-AGI-3 게임을 직접 플레이해봤는데, 인간은 몇 번 시행착오를 거치면 규칙을 파악합니다. "아, 이 블록은 이렇게 움직이는구나" 하고 패턴을 잡죠. 그런데 현재 AI는 이 "아하!" 순간을 만들어내지 못합니다. 그게 바로 이 벤치마크가 측정하려는 겁니다.

🏁 마무리

ARC-AGI-3은 AI 업계에 불편한 질문을 던집니다. "우리가 만들고 있는 AI, 정말 '지능적'인 건가, 아니면 엄청 잘 외우는 건가?" 인간은 100%, AI는 1% 미만 — 이 격차가 좁혀지는 날이 진짜 AGI에 한 발 다가서는 날일 겁니다.

AI 에이전트를 만들고 있는 분이라면, 공식 사이트에서 직접 게임을 플레이해보시고, SDK 문서를 통해 자기 에이전트를 테스트해보세요. 상금도 상금이지만, "내 에이전트는 얼마나 진짜 '생각'할 수 있나?"를 확인하는 것 자체가 가치 있을 겁니다.

이 글은 Hacker News의 ARC-AGI-3 소식과 Fast Company의 독점 인터뷰, ARC Prize 공식 사이트를 참고하여 작성했습니다.