Meta HyperAgents 완벽 분석: AI가 스스로를 개선하는 방법까지 스스로 개선하는 시대가 왔다

목차

- 🔍 괴델 머신에서 다윈 괴델 머신까지

- 🧠 HyperAgents — "개선하는 방법"을 개선하다

- 📊 실험 결과: 도메인을 넘나드는 성능 향상

- ⚙️ 코드 구조와 실행 방법

- 🔑 왜 이게 중요한가

- 📌 마무리

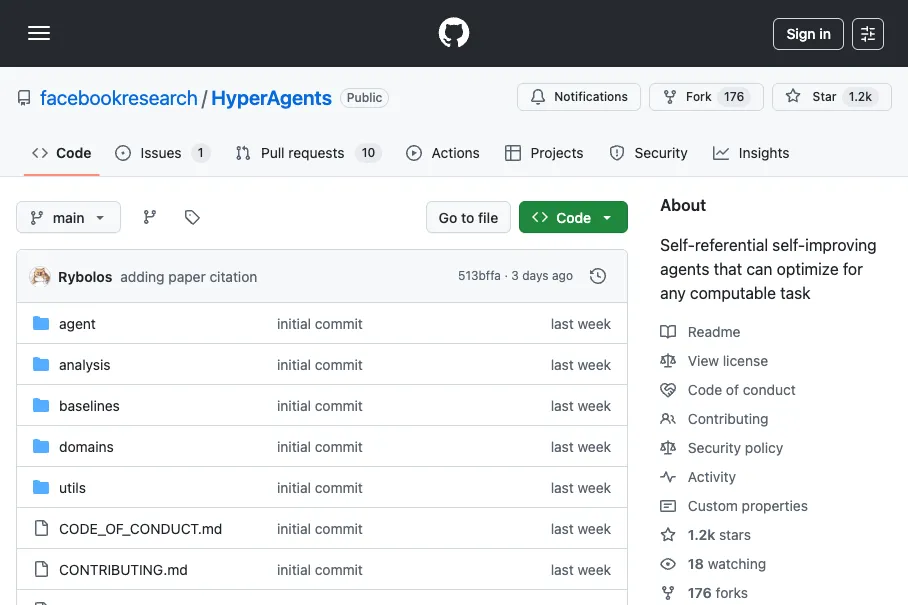

"AI가 스스로 더 똑똑해진다"는 말은 이제 흔하죠. 그런데 "AI가 더 똑똑해지는 방법 자체를 스스로 개선한다"면 어떨까요? Meta(Facebook) 연구팀이 공개한 HyperAgents가 정확히 그걸 해냅니다. ICLR 2026에 정식 수락된 이 논문은 공개 일주일 만에 GitHub 스타 1,200개를 돌파하며 AI 커뮤니티를 뒤흔들고 있습니다.

🔍 괴델 머신에서 다윈 괴델 머신까지

HyperAgents를 이해하려면 먼저 그 뿌리인 괴델 머신(Gödel Machine)을 알아야 합니다. LSTM의 아버지 위르겐 슈미트후버(Jürgen Schmidhuber)가 20년 전 제안한 개념인데, 핵심은 간단합니다:

"더 나은 전략이 수학적으로 증명되면, AI가 스스로 자기 코드를 다시 쓴다."

멋진 아이디어지만 현실에선 문제가 있었습니다. 실제 복잡한 태스크에서 "이 변경이 정말 이득인지" 수학적으로 증명하는 건 거의 불가능하거든요.

이 한계를 돌파한 게 다윈 괴델 머신(DGM, Darwin Gödel Machine)입니다. 수학적 증명 대신 오픈엔디드 진화 알고리즘을 사용합니다. LLM이 코드 개선안을 제안하고, 실제로 돌려본 뒤 성능이 좋은 것만 살려서 에이전트 라이브러리를 점점 키워나가는 방식이죠. 다윈의 자연선택을 코드 세계에 적용한 셈입니다.

실제로 DGM은 SWE-bench에서 성능을 20.0%에서 50.0%로 끌어올렸습니다. 자기 코드를 반복적으로 수정하면서요.

🧠 HyperAgents — "개선하는 방법"을 개선하다

그런데 DGM에는 치명적인 한계가 있습니다. 프로그래밍 태스크에서만 잘 동작한다는 겁니다.

왜냐하면 DGM의 자기 개선 메커니즘 자체가 "코드 수정"이기 때문입니다. 코딩 능력이 올라가면 자기 코드를 수정하는 능력도 자연스럽게 올라가죠. 하지만 시를 쓰는 AI가 아무리 시를 잘 쓰게 되더라도, 그걸로 자기 소스 코드를 더 잘 고칠 수 있는 건 아닙니다.

HyperAgents는 이 문제를 Task Agent와 Meta Agent를 하나의 편집 가능한 프로그램으로 통합해서 해결합니다:

- Task Agent: 실제 문제를 푸는 에이전트 (코딩, 글쓰기, 수학 등)

- Meta Agent: Task Agent와 자기 자신을 수정하는 에이전트

핵심은 Meta Agent가 자기 자신도 수정 대상이라는 점입니다. 개선 방법을 생성하는 메타 수준의 절차까지 편집 가능하기 때문에, 도메인에 상관없이 메타인지적 자기 수정(metacognitive self-modification)이 가능합니다.

비유하자면 이렇습니다. 기존 DGM은 "선수가 훈련해서 실력이 느는" 구조였다면, HyperAgents는 "코치가 더 나은 코칭법을 스스로 학습하고, 그 덕에 선수도 더 빨리 성장하는" 구조입니다. 코치의 코칭 능력과 선수의 경기 능력이 함께 나선형으로 상승하는 거죠.

📊 실험 결과: 도메인을 넘나드는 성능 향상

DGM-Hyperagents(DGM-H)의 실험 결과는 인상적입니다:

- SWE-bench: 20.0% → 50.0% (자기 코드 라이브러리 반복 수정)

- Polyglot 벤치마크: 14.2% → 30.7% (Aider 같은 수작업 에이전트 대비 압도적)

- 크로스 모델 전이: Claude 3.5 Sonnet에서 최적화한 에이전트가 o3-mini나 Claude 3.7 Sonnet에서도 성능 향상

- 크로스 언어 전이: Python 태스크에서 개선된 에이전트가 Rust, C++, Go에서도 성능 개선

특히 주목할 점은 메타 수준의 개선이 도메인 간에 전이된다는 것입니다. 한 도메인에서 학습한 "더 나은 개선 방법"이 다른 도메인에서도 작동하고, 실행을 거듭할수록 누적됩니다. 이건 단순한 태스크 최적화와는 차원이 다른 이야기입니다.

⚙️ 코드 구조와 실행 방법

HyperAgents는 Python 기반 오픈소스 프로젝트로, 구조가 깔끔합니다:

hyperagents/

├── agent/ # 파운데이션 모델 호출 코드

├── domains/ # 각 도메인별 태스크 코드

├── meta_agent.py # Meta Agent 구현 (핵심!)

├── task_agent.py # Task Agent 구현

├── generate_loop.py # 진화 루프 진입점

├── select_next_parent.py # 다음 부모 에이전트 선택

└── baselines/ # 비교 베이스라인실행은 간단합니다:

# 환경 설정

python3.12 -m venv venv_nat

source venv_nat/bin/activate

pip install -r requirements.txt

# 초기 에이전트 설정

bash ./setup_initial.sh

# 진화 루프 실행

python generate_loop.py --domains <domain></domain>OpenAI, Anthropic, Gemini API 키가 모두 필요합니다. .env 파일에 설정하면 됩니다. Docker 빌드도 지원하므로, 격리된 환경에서 실행하는 걸 강력히 추천합니다. 왜냐하면 이 프로젝트는 모델이 생성한 코드를 직접 실행하기 때문입니다. README에도 안전 경고가 명시되어 있습니다.

🔑 왜 이게 중요한가

HyperAgents가 중요한 이유를 정리하면:

- 도메인 제한 탈피: 기존 자기 개선 AI는 코딩에만 효과적이었지만, HyperAgents는 "임의의 계산 가능한 태스크"에 적용 가능

- 메타 학습의 실현: "개선하는 방법을 개선한다"는 개념이 실제 벤치마크에서 작동함을 증명

- 전이 가능성: 한 도메인에서의 메타 수준 개선이 다른 도메인에도 적용됨

- 오픈소스: 전체 코드, 실험 로그까지 공개 — 재현 가능한 연구

물론 주의할 점도 있습니다. 논문 저자들도 강조하듯이, 자기 코드를 수정하는 AI는 안전성 문제가 뒤따릅니다. 현재 설정과 사용 모델에서는 악의적 행동 가능성이 매우 낮지만, 모델 능력이 향상됨에 따라 더 정교한 안전장치가 필요할 것입니다.

📌 마무리

HyperAgents는 "AI가 더 나은 해결책을 찾는 것에서 그치지 않고, 해결책을 찾는 방법을 지속적으로 개선하는" 오픈엔디드 AI 시스템의 가능성을 보여줍니다. ICLR 2026 수락, 일주일 만에 GitHub 스타 1.2k — 커뮤니티 반응을 보면 이 방향이 얼마나 주목받고 있는지 알 수 있습니다.

AI 에이전트를 만들거나 연구하는 분이라면, GitHub 레포지토리와 arXiv 논문을 한번 살펴보시길 추천합니다. 특히 meta_agent.py와 generate_loop.py를 읽어보면 메타 수준 자기 개선이 실제로 어떻게 구현되는지 감을 잡을 수 있을 겁니다.

이 글은 Hacker News에 올라온 HyperAgents 논문 토론을 참고하여 작성했습니다.

참고 자료: